原标题:AI芯片发展百花齐放 一文回顾AI芯片发展的前世今生

现代电子产品和设备在诸如通信、娱乐、安全和医疗保健等许多方面改善了我们的生活质量,这主要是因为现代微电子技术的发展极大地改变了人们的日常工作和互动方式。在过去几十年中,摩尔定律一直是通过不断缩小芯片上的器件特征尺寸来提高计算能力,带来了电子产品诸如更高速度、更低成本和更小功耗等优势。GordonMoore最初的观察是芯片中的晶体管数量大约每2年增加1倍,DavidHouse进一步预测,由于更多更快的晶体管,芯片性能将每18个月翻一番。虽然GordonMoore的预测已经成功超过50年,但是今天的硅CMOS技术正在接近其尺寸的基本物理极限,摩尔定律的延续性已经变得越来越具有挑战性。

这意味着电子产品和设备的性能增益不再仅仅依赖于器件特征尺寸的缩小,人们有必要发明新的IT技术或新的计算原理,以满足应用对计算能力和低功耗等方面不断增长的需求,而人工智能的出现为突破这种局限性提供了无限可能。人工智能(artificialintelligence,AI)指由人制造出来的机器来呈现人类智能的技术,而人工智能芯片指能够运行人工智能技术和相关算法的半导体芯片。本文将对人工智能芯片的研究进展及市场发展进行介绍。

人工智能芯片的发展

据了解,人工智能(AI)技术的发展和应用在美国、中国和欧盟等世界主要国家中已经成为国家战略,在国家的科技发展和产业竞争中占据越来越重要的位置。同时,AI技术在手写识别(例如MNIST数据集[1])、人脸识别(例如Facebook的DeepFace[2])、语音识别(例如亚马逊的Alexa[3]、Apple的Siri[4]、微软的Cortana[5])、机器人技术(例如机器人操作系统[6])、自动驾驶(例如TartanRacing[7]),甚至智力游戏(例如Google的AlphaGo[8])和视频游戏(例如Pac-mAnt[9])等领域得到了广泛应用。随着人工智能的发展,产生了更多的专业技术,比如神经网络模型、机器学习等,依靠经验学习而不是编程来做出决策。反过来,机器学习为深度学习奠定了基础,深度学习涉及分层算法,以便更好地理解数据。

自20世纪50年代开始,人类对人工智能技术的探索从来就没有停止过。“人工智能”一词是由科学家约翰·麦卡锡(JohnMcCarthy)、克劳德·香农(ClaudeShannon)和马文·明斯基(MarvinMinsky)于1956年在达特茅斯会议上提出的,从此揭开人工智能研究的序幕。1962年Rosenblatt出版《神经动力学原理》及其1957年设计的模拟计算器,被视作深度神经网络模型的算法原型。1969年,Minsky与Papert出版《感知器》,指出单层神经网络训练出来的图像识别算法连对称图形都无法正确识别。

对于多层神经网络,由于人造神经元的运算极限严重受限于当时计算机的算力不足,导致多层神经网络也无法被当时和后来的计算机的芯片运算效能实现,这造成了人工神经网络领域在1970年代的寒冬时期。

1982年,日本开始第五代计算机项目研究计划,同时美国也投入不少资源在第五代计算机的研发中,但最终依然无法解决图像和音讯识别的重大问题。1985年,Hinton与Sejnowski发表了之前被视为不可能实现的基于玻尔兹曼机的“多层神经网络”,1986年,Rumelhart和Hinton发表“BP反向传播算法”,1989年,贝尔实验室成功利用反向传播算法,在多层神经网络开发了一个手写邮编识别器。同年,Mead出版AnalogVLSIandNeuralSystems,开创了基于仿生芯片的神经形态工程领域。

1993年,YannLeCun的团队使用DSP在一台486电脑上实现深度学习算法,其作为推理芯片,已可辨识手写的数字。至此,通用芯片CPU的算力大幅提升,但仍无法满足多层神经网络的计算能力需求。1994年,MichaelGschwind等使用FPGAs实现神经网络的算法应用,1998年,YannLeCun和YoshuaBengio发表了手写识别神经网络和反向传播优化相关的论文“Gradient-basedlearningappliedtodocumentrecognition”,开创了卷积神经网络时代的到来。

2006年,Hinton提出受限玻尔兹曼机模型与深度信念网络,成功地训练多层神经网络,解决了反向传播算法局部最佳解问题,并把多层类神经网络称作“深度学习”,首次证明了大规模深度神经网络学习的可能性。2007年,英伟达开发出统一计算架构(CUDA),研究人员透过CUDA可以轻松使用C语言开发GPU,使得GPU具有方便的编程环境可以直接编写程序。2008年,英伟达推出Tegra芯片,作为最早的可用于人工智能领域的GPU,如今已成为英伟达最重要的AI芯片之一,主要用于智能驾驶领域。2009年,RajatRaina和吴恩达联合发表利用GPU完成深度学习训练的论文“Large-scaleDeepUnsupervisedLearningUsingGraphicProcessors”。2010年,IBM首次发布类脑芯片原型模拟大脑结构,该原型具有感知认知能力和大规模并行计算能力。

2012年,Krizhevsky与Hinton的团队采用GPU架构结合卷积神经网络(CNN)算法,在ImageNet大赛中,将图像识别错误率降到18%,并在NIPS会议上发表图像识别论文“ImageNetClassificationwithDeepConvolutionalNeuralNetworks”。这一突破性的成果,让人们第一次惊喜地看到神经网络的算力需求可被现行计算设备满足。不过,这一成果也有它的美中不足:他们使用的GPU架构芯片并非针对神经网络架构设计,其中包含许多运行神经网络时不需要的架构设计,因此效率提升有限。就在同一年,GoogleBrain用1.6万个GPU核的并行计算平台训练DNN模型,在语音和图像识别等领域获得巨大成功,2013年GPU开始广泛应用于人工智能领域,高通公司发布Zeroth。2014年,中国科学研究院的陈天石博士(寒武纪创办人)团队发表以DianNao[10]为名的人工智能专用加速芯片系列论文(包含DaDianNao[11]、PuDianNao[12]、ShiDianNao[13]、Cambricon-X),开启人工智能加速专用芯片(ASIC)的研究领域。也在同年,英伟达发布 为深度学习设计的GPU架构Pascal,IBM发布第二代TrueNorth。

2015年,JasonCong在当年的国际FPGA大会上,发表1篇FPGA加速DNN算法的论文“OptimizingFPGA-basedAcceleratorDesignforDeepConvolutionalNeuralNetworks”,使得FPGAs迅速大火。很快地,2016年,Google发表TensorFlow框架设计的TPU芯片,而同年,采用TPU架构的AlphaGo出现,并击败人类世界冠军棋士李世石。还是在同年,寒武纪研发出DIANNAO,FPGA芯片在云计算平台得到广泛应用。仅仅在2017年,谷歌TPU2.0发布,加强了训练效能[14];英伟达发布Volta架构,推进GPU的效能大幅提升;华为麒麟970成为 手机AI芯片;清华大学魏少军教授团队开发出Thinker原型,并随后推出在算力和能效方面具有国际水平的系列Thinker人工智能芯片。

人工智能芯片的分类

2.1传统CPU困局

自20个世纪60年代早期开始,CPU(中央处理器)开始出现并使用在计算机工业中。现如今,虽然CPU在设计和实现上都发生了巨大变化,但是基于冯·诺依曼架构的CPU基本工作原理却一直没有发生很大变化。如图1所示,冯·诺依曼架构分为中央处理单元(CPU)和存储器,CPU主要由控制器和运算器两大部件组成[15]。在工作时,CPU每执行一条指令都需要从存储器中读取数据,根据指令对数据进行相应的操作,因此CPU不仅负责数据运算,而且需要执行存储读取、指令分析、分支跳转等命令。同时可以通过提升单位时间内执行指令的条数,即主频,来提升计算速度。但在人工智能深度学习领域中程序指令相对较少,但对大数据的计算需求很大,需要进行海量的数据处理。当用CPU执行AI算法时,CPU将花费大量的时间在数据/指令的读取分析上,在一定的功耗前提下,不能够通过无限制的加快CPU频率和内存带宽来达到指令执行速度无限制的提升。因此在这种情形下,传统CPU结构缺点明显,在人工智能芯片领域中的算力瓶颈问题很难解决。

2.2 人工智能芯片中的后CPU时代

基于 CPU 的算力问题 ,近年来人工智能芯片领 域的科学家们进行了富有成果的广泛研究 ,主要集中在 AI 芯片目前的两种发展方向。一个方向是继续延续经典的冯 · 诺依曼计算架构 ,以加速计算能力为发展目标,主要分为并行加速计算的GPU(图形处理单元)、半定制化的 FPGA(现场可编程门阵列)、全定制化的 ASIC(专用集成电路)。另一个方向就是颠覆传统的冯 · 诺依曼计算架构 ,采用基于类脑神经结构的神经拟态芯片来解决算力问题。下面将对这两个方向的人工智能芯片特点进行详细描述。

2.2.1 按架构分类

( 1)图 形 处 理 单 元( graphics processing unit ,GPU)。GPU 是相对较早的加速计算处理器 ,具有速度快、芯片编程灵活简单等特点。由于传统CPU 的计算指令遵循串行执行方式 ,不能发挥出芯片的全部潜力 ,而 GPU 具有高并行结构 ,在处理图形数据和复杂算法方面拥有比 CPU 更高的效率。在结构上 ,CPU 主要由控制器和寄存器组成 ,而 GPU 则拥有更多的逻辑运算单元(arithmetic logic unit,ALU)用于数据处理,这样的结构更适合对密集型数据进行并行处理 ,程序在 GPU 系统上的运行速度相较于单核 CPU 往往提升几十倍乃至上千倍。同时 ,GPU拥有了更加强大的浮点运算能力 ,可以缓解深度学习算法的训练难题,释放人工智能的潜能。但是GPU 也有一定的局限性。深度学习算法分为训练和推断两部分 ,GPU 平台在算法训练上非常高效。但在推断中对于单项输入进行处理的时候 ,并行计算的优势不能完全发挥出来 。

( 2)现场可编程门阵列( field programmable gatearray , FPGA )。 FPGA 是 在 PAL 、 GAL 、 CPLD 等 可 编程器件基础上进一步发展的产物。其基本原理是在 FPGA 芯片内集成大量的基本门电路以及存储器 ,用户可以通过更新 FPGA配置文件(即烧入)来定义这些门电路以及存储器之间的连线。这种烧入不是一次性的,因此,它既解决了定制电路灵活性的不足,又克服了原有可编程器件门电路数有限的缺点。与 GPU 不同 , FPGA 同时拥有进行数据并行和任务并行计算的能力 ,适用于以硬件流水线方式处理一条数据 ,且整数运算性能更高 ,因此常用于深度学习算法中的推断阶段。不过 FPGA 通过硬件的配置实现软件算法 ,因此在实现复杂算法方面有一定的难度 。

将 FPGA和 CPU对比可以发现两个特点,一是 FPGA没有内存和控制所带来的存储和读取部分,速度更快,二是 FPGA没有读取指令操作,所以功耗更低。劣势是价格比较高,编程复杂,整体运算能力不是很高。功耗方面 ,从体系结构而言 , FPGA 也具有天生的优势。传统的冯氏结构中,执行单元(如 CPU核)执行任意指令,都需要有指令存储器 、译码器 、各种指令的运算器及分支跳转处理逻辑参与运行,而 FPGA每个逻辑单元的功能在重编程(即烧入)时就已经确定 ,不需要指令,无需共享内存 ,从而可以极大地降低单位执行的功耗 ,提高整体的能耗比。 FPGA最值得注意的例子可能是 CNP [16] ,它进一步改进并重命名为 NeuFlow [17] ,后来改编为 nn-X [18]。这 些设计可以实现 10~100 KM/s 操作(GOPS),功率仅为10W以下。

( 3)专用集成电路( application-specific integratedcircuit, ASIC)。目前以深度学习为代表的人工智能计算需求,主要采用 GPU、 FPGA等已有的适合并行计算的通用芯片来实现加速。在产业应用没有大规模兴起之时 ,使用这类 GPU 、 FPGA 已有的通用芯片可以避免专门研发定制芯片( ASIC )的高投入和高风险。但是,由于这类通用芯片设计初衷并非专门针对深度学习 ,因而天然存在性能 、功耗等方面的局限性。随着人工智能应用规模的扩大 ,这类问题日益突显。

GPU 作为图像处理器 ,设计初衷是为了应对图像处理中的大规模并行计算。因此 ,在应用于深度学习算法时无法充分发挥并行计算优势。深度学习包含训练和推断两个计算环节 , GPU 在深度学习算法训练上非常高效 ,但对于单一输入进行推断的场合 ,并行度的优势不能完全发挥。其次, GPU采用 SIMT计算模式 ,硬件结构相对固定 ,无法灵活配置硬件结构 。此外,运行深度学习算法能效低于 FPGA。

虽然 FPGA 倍受看好 ,但其毕竟不是专门为了适用深度学习算法而研发 ,实际应用中为了实现可重构特性 , FPGA 内部有大量极细粒度的基本单元 ,但是每个单元的计算能力都远低于 CPU 和 GPU 中的 ALU 模块;其次 ,为实现可重构特性 , FPGA 内部大量资源被用于可配置的片上路由与连线 ,因此计算资源占比相对较低;再者,速度和功耗相对专用定制芯片( ASIC)仍然存在不小差距;而且 FPGA价格较为昂贵,在规模放量的情况下单块 FPGA的成本要远高于专用定制芯片。

因此 ,随着人工智能算法和应用技术的日益发展,以及人工智能专用芯片 ASIC产业环境的逐渐成熟 ,全定制化人工智能 ASIC 也逐步体现出自身的优势。 ASIC是专用定制芯片,定制的特性有助于提高 ASIC 的性能功耗比 ,缺点是电路设计需要定制 ,相对开发周期长 ,功能难以扩展。但在功耗 、可靠性 、集成度等方面都有优势 ,尤其在要求高性能 、低功耗的移动应用端体现明显。比如谷歌的 TPU、寒武纪的 GPU ,地平线的 BPU 都属于 ASIC 芯片 。

( 4)神经拟态芯片(类脑芯片)。在人工智能芯片中,传统的冯·诺依曼架构存在着“冯·诺依曼瓶颈”,它降低了系统的整体效率和性能 [19]。为了从根本上克服这个问题 ,神经形态计算近年来已成为基于冯 · 诺依曼系统的这些传统计算架构的最有吸引力的替代方案。术语“神经形态计算”首先由 Mead[20] 在 1990 年提出 ,它是一种受大脑认知功能启发的新计算范式。与传统的 CPU / GPU 不同 ,生物脑(例如哺乳动物的大脑)能够以高效率和低功耗在小区域中并行处理大量信息。因此 ,神经形态计算的最终目标是开发神经形态硬件加速器 ,模拟高效生物信息处理,以弥合网络和真实大脑之间的效率差距 [21] ,这被认为是下一代人工智能的主要驱动力。

神经拟态芯片不采用经典的冯 · 诺依曼架构 ,而是基于神经形态架构设计 ,是模拟生物神经网络的计算机制 ,如果将神经元和突触权重视为大脑的“处理器”和“记忆”,它们会分布在整个神经皮层 [22]。神经拟态计算从结构层面去逼近大脑 ,其研究工作可分为两个层次 ,一是神经网络层面,与之相应的是神经拟态架构和处理器 ,以 IBM Truenorth 为代表 ,这种芯片把定制化的数字处理内核当作神经元 ,把内 存作为突触。

其逻辑结构与传统冯·诺依曼结构不同:内存、CPU和通信部件完全集成在一起,因此信息的处理在本地进行 ,克服了传统计算机内存与CPU 之间的速度瓶颈问题。同时神经元之间可以方便快捷地相互沟通 ,只要接收到其他神经元发过来的脉冲(动作电位),这些神经元就会同时做动作;二是神经元与神经突触层面 ,与之相应的是元器件层面的创新。如 IBM 苏黎世研究中心宣布制造出世界上 人造纳米尺度的随机相变神经元,可实现高速无监督学习 。

当前 , 的神经拟态芯片仍然远离人类大脑的规模(1010个神经元,每个神经元有103~104个突触),至多达到104 倍,如表1所示。为了达到在人脑中规模,应将多个神经拟态芯片集成在电路板或背板上 ,以构成超大规模计算系统。神经拟态芯片的设计目的不再仅仅局限于加速深度学习算法 ,而是在芯片基本结构甚至器件层面上改变设计 ,希望能够开发出新的类脑计算机体系结构,比如采用忆阻器和 ReRAM 等新器件来提高存储密度。这类芯片技术尚未完全成熟 ,离大规模应用还有很长的距离 ,但是长期来看类脑芯片有可能会带来计算机体系结构的革命 。

2.2.2 按功能分类

根据机器学习算法步骤 ,可分为训练( training) 和推断( inference )两个环节 。训练环节通常需要通过大量的数据输入,训练出一个复杂的深度神经网络模型。训练过程由于涉及海量的训练数据和复杂的深度神经网络结构 ,运算量巨大 ,需要庞大的计算规模 ,对于处理器的计算能力 、精度 、可扩展性等性能要求很高。目前市场上通常使用英伟达的 GPU 集群来完成 ,Google 的TPU2.0/3.0 也支持训练环节的深度网络加速 。

推断环节是指利用训练好的模型 ,使用新的数据去“推断”出各种结论。这个环节的计算量相对训练环节少很多 ,但仍然会涉及到大量的矩阵运算 。在推断环节中 ,除了使用 CPU 或 GPU 进行运算外 , FPGA 以及 ASIC 均能发挥重大作用。表 2 是 4 种技术架构的芯片在人工智能系统开发上的对比 。

2.2.3按应用场景分类

主要分为用于服务器端(云端)和用于移动端(终端)两大类。

服务器端:在深度学习的训练阶段,由于数据量及运算量巨大,单一处理器几乎不可能独立完成1个模型的训练过程,因此,负责AI算法的芯片采用的是高性能计算的技术路线,一方面要支持尽可能多的网络结构以保证算法的正确率和泛化能力;另一方面必须支持浮点数运算;而且为了能够提升性能必须支持阵列式结构(即可以把多块芯片组成一个计算阵列以加速运算)。在推断阶段,由于训练出来的深度神经网络模型仍非常复杂,推断过程仍然属于计算密集型和存储密集型,可以选择部署在服务器端。

移动端(手机、智能家居、无人车等):移动端AI芯片在设计思路上与服务器端AI芯片有着本质的区别。首先,必须保证很高的计算能效;其次,在高级辅助驾驶ADAS等设备对实时性要求很高的场合,推断过程必须在设备本身完成,因此要求移动端设备具备足够的推断能力。而某些场合还会有低功耗、低延迟、低成本的要求,从而导致移动端的AI芯片多种多样。

人工智能芯片研究现状

3.1研究背景

人工智能芯片的核心为神经网络算法的实现。深度神经网络(DNN)已经在自然语言处理、机器视觉、语音识别、医学影像分析等众多人工智能领域取得了重大突破[28-29]。深度学习主要分为传统卷积神经网络(CNN)和递归神经网络(RNN),其依赖于大数据集的反复训练和大量浮点运算推理运算,这对计算机算力要求较高,训练时间长,功耗极大。以AlphaGo为例,其基于1920个中央处理单元和280个图形处理单元,功耗为1MW,这几乎是人脑能耗(~20W)的5万倍。近年来,人工智能被视为有极大的潜力应用于物联网和边缘计算领域中,因此需要具备高能效、快速预测,在线学习的能力,以避免向后端或服务器发送大量的数据[30-32]。

人工智能算法、架构、电路、器件等各个层面得到了很大的改进和优化,以减少推理的能量消耗,同时保持分类精度等性能指标[30,32-34]。通过定制ASIC设计实现节能推理硬件加速器的工作已经实现了相当高的能效(1TFlops/W),但基于反向传播的深度学习算法需要频繁地从远程传播误差信号,因此很难实现有效的在线学习。由于能量效率低下和缺乏有效的在线学习方法,以CNN和RNN为代表的许多深度学习算法不适合以事件驱动和对能效要求极高的新兴人工智能应用,例如物联网智能传感器和边缘计算等[31-32,35]。

在此背景下,人工智能领域科学家提出脉冲神经网络(SNN),其被誉为第三代人工神经网络。

SNN在神经元模型之间使用时序脉冲序列来表示、传输和处理信息,来保证了更快的在线学习和更高的能量效率。相比传统的人工神经网络(CNN和RNN),SNN具备了更多独特的仿脑特性,包括信息的脉冲表示、事件驱动的信息处理和基于脉冲的局部学习规则等,更加接近于生物神经网络中的学习和记忆机制。因此,由于脉冲神经网络其快速的在线学习、极高的能量效率、与人脑的高度相似性,近年来是人工智能科学领域极具科学意义的研究课题[36-37]。

3.2研究现状

近年来,世界上著名的学术研究机构和国际半导体公司都在积极研究和开发基于脉冲的神经拟态电路[38-45]。如表3所示,基于SNN的神经拟态计算硬件比基于传统DNN的硬件加速器具有更高的能量效率。大多数 的神经拟态计算芯片[39-41,44]都是基于成熟的CMOS硅技术对SNN进行ASIC设计,通过SRAM等存储器模拟实现人工突触,并利用关键的数字或模拟电路仿生实现人工神经元。其中最具有代表性的是IBM公司研发的基于CMOS多核架构TrueNorth芯片[40],当模拟100万个神经元和2亿5000万个突触时,该芯片仅消耗70mW的功耗,每个突触事件仅消耗26pJ的极高能量效率。然而,为了模仿生物突触和神经元的类脑特性,电子突触和神经元需要高度复杂的CMOS电路来实现所需的人工突触和神经元的功能,如图2所示。

以IBM的TrueNorth芯片为例,它包含54亿个晶体管,在28nm工艺下占据4.3cm2的面积。因此,这一类基于脉冲的神经拟态CMOS硬件电路使用大量的晶体管,并导致耗费非常大的芯片面积。加之,现有的大多数神经拟态芯片[39-41,44]由于其计算单元与存储单元在局部依然是分离的,这在用于神经元的CMOS逻辑电路和用于突触的SRAM电路之间依然存在局部的存储壁垒问题和能量效率问题,所以实际上还不是真正意义上的非冯·诺依曼体系结构。不过最新的具有三维堆叠能力的非易失性存储器(NVM)技术或存内计算技术(in-memorycomputing)有望解决这一问题。

另一项由 IBM 开发的基于新型 NVM 技术的脉冲神经网络功能芯片[42] 证明了在非冯 · 诺依曼体系结构中使用相变存储器(PCRAM)这一创新的 NVM技术能够实现极低的能耗(仅为 0.9 pJ/bit)。由占据在交叉点的相变存储电阻组成了十字交叉整列结构 ,连同 CMOS 模拟电路一起实现脉冲时序依赖可塑性(STDP)学习规则的突触可塑性功能和带泄漏积分放电(LIF)的神经元功能 ,如图 3 所示。但是 ,由于预测精度的问题 ,该芯片只能执行简单的应用任务 ,完成基本模式的联想学习。IBM 的基于脉冲的神经拟态芯片反映了在人工神经元和突触 ,以及新兴的 NMV 技术的研究领域里最新的科研进展。

在借鉴国外研究工作的同时 ,我国也大力发展基于脉冲的神经拟态芯片研究。清华大学团队提出一款基于 CMOS 技术的多核架构类脑芯片天机一号 [44] ,实现了支持 LIF 的人工神经元功能。北京大学团队提出了一种基于忆阻器阵列的神经拟态芯片 [45] ,实现了简化的 LIF 功能和简单的赫伯学习机制。忆阻器是一种新型的 NVM 器件 ,具有独特的模拟特性和可扩展性 ,并且由于其出色的能耗效率和器件特性 ,可以进一步提高神经拟态芯片的集成规模和整体效能 [46-52] 。

至今基于脉冲的神经拟态芯片的主要研究方法是通过对生物神经科学中已发现的生物行为特征进行直接模拟和仿生实现 ,包括算法建模 、电路创新 、新型器件技术等各个层面的研究和探索。虽然基于神经拟态计算算法的人工智能芯片技术近年来已得到很大的发展和进步 ,但是依然难以实现所有的已知生物学习机制 ,仅通过对 SNN 模型的优化来达到近似或模仿一些生物现象从而实现一些 简单的学习功能 ,比如路径规划和手写识别。这些简化的类脑模型包括基于脉冲时序依赖的更新规则的突触模型和基于确定的线性积分放电动态的神经元模型[40-41] 。

人工智能芯片产业现状

4.1 产业现状评述

AI 芯片是芯片产业和人工智能产业整合的关 键 ,特别是 AI 系统芯片。根据 Gartner 的预测数据 ,未来 5 年内全球人工智能芯片市场规模将呈飙升趋势 ,自 2018 年的 42.7 亿美元 ,升高至 343 亿美元 ,增长已超过7倍,可见AI芯片市场有较大增长空间,如图4所示。

对于中国 AI 芯片市场 ,根据中国信通院的数据报告 ,中国的人工智能市场规模预计在 2018 年超过 300 亿人民币 ,而 2019 年后将超过 500 亿人民币。市场年度增长率 ,将从 2017 年的 52.8%上升至 2018 年的 56.3% ,随后逐年下降 ,在 2020 年降至 42.0%。其 中 ,2017 年芯片销售额占人工智能市场规模的 22% ,约47.7亿人民币,如图5所示。

现今 ,中国已有超过 20 家以上的新创 AI 芯片设计企业 ,融资总额超过 30 亿美元。 AI 芯片行业生命周期正处于幼稚期 ,市场增长快 ,至 2022 年将从 2018 年的 42.7 亿美元 ,发展至 343 亿美元 ,但芯片企业与客户的合作模式仍在探索中。为了生存 ,行业逐渐出现上下游整合的趋势。云端(含边缘端)服务器 、智慧型手机和物联网终端设备等 3 个场景 ,是目前 AI 芯片企业的主要落地市场 ,少数企业则是面向未来的自动驾驶汽车市场。这些市场都具有千万量级出货量或百亿美元销售额等特征 。

然而 ,中国长期面临集成电路的进口额大于出口额的情况 ,根据海关总署的统计 ,如图 6 所示 , 2018 年进口总额正式突破 3 000 亿美元 ,约达 3 121 亿美元 ,同比 2017 年增长了 19.8%。相较之下 ,集成电路的出口总额在 2018 年时仅 846 亿美元 ,尚不到进口额的 1/3 ,而同年原油进口额约为 2 400 亿美元 ,由此可见, 中国极度依赖于国外芯片制造商。目前国内芯片制造技术尚待提高,但由于半导体的分工模式相当成熟 ,国内芯片设计企业并不需要担心芯片生产问题 。

4.2AI芯片产业链

AI芯片产业链主要分成设计—制造/封测—系统。

(1)上游:主要是芯片设计,按商业模式,可再细分成3种:IP设计、芯片设计代工和芯片设计。IP设计即设计芯片用的IP核(IPcore)。

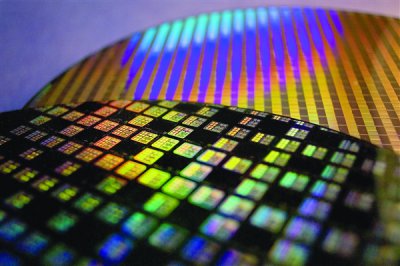

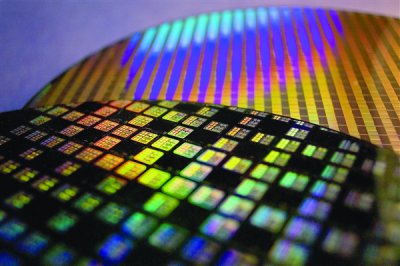

(2)中游:包含两大类,分别是晶圆制造和封装测试,晶圆不仅是在封装时测试,制造后也会有一次测试,封装后再有一次。

(3)下游:分成销售和系统集成(systemintegration)企业,其中提供软硬件集成解决方案的企业会被归属在系统集成商中,例如人工智能解决方案商。

4.3AI芯片商业模式

按半导体上游与中游的集成与否,市场分成两种商业模式。

(1)垂直集成模式:又称IDM,归属于该模式的企业业务同时包含设计和制造/封测。IDM模式的代表企业是英特尔和三星。

(2)垂直分工模式:采取分工模式的企业仅只专营一项业务,比如英伟达和华为海思仅有芯片设计,没有制造业务,称作Fabless;而台积电和中芯国际仅代工制造,不涉及芯片设计,称作Foundry。

4.4AI芯片设计产业模式

芯片设计的产业模式分为IP设计、芯片设计代工和芯片设计3种。

(1)IP设计:IP设计相较于芯片设计是在产业链的更顶层,以IP核授权收费为主。传统的IP核授权企业以安谋(Arm)为代表,新创的AI芯片企业虽然也可设计出新型IP核,但因授权模式不易以规模效应创造出可观的收入,新创企业一般不以此作为主要盈利模式。另外还有提供自动化设计(EDAtool)和芯片设计验证工具的Cadence和Synopsys,也在积极部署人工智能专用芯片领域。

(2)芯片设计代工:芯片设计代工和制造业的代工一样,提供设计代工服务的企业,并不能在产品上贴上自己的标签,也不能对外宣称该产品由自己设计。芯原科技已经从事相关服务多年,也和恩智浦(NXP)有合作关系。

(3)芯片设计:大部分的人工智能新创企业是以芯片设计为主,但在这个领域中存在传统强敌,如英伟达、英特尔、赛灵思(Xilinx)和恩智浦,因而目前只有少数新创AI芯片设计企业会进入传统芯片企业的产品领域,例如,寒武纪与英伟达竞争服务器芯片市场,地平线与英伟达及恩智浦竞争自动驾驶芯片市场,其余企业则是在物联网场景上布局,像是提供语音辨识芯片的云知声,提供人脸辨识芯片的中星微,以及提供边缘计算芯片的耐能科技。

半导体的垂直分工模式虽有助于纯芯片设计企业的生存,不过单一芯片难以单独实现复杂功能,于是有些企业开始提供芯片集成服务,集成后的产品称作系统或IC(integratedcircuit)模块,在人工智能领域则称为AI系统或AI模块。一般而言,人工智能企业会同时提供算法和芯片的集成服务,该类企业通常被称为“人工智能方案解决商”,或称AI一站式服务(AITurnkey)。

4.5AI芯片产品类型

根据集成的产品类型可再分成两类,即硬件集成和软件集成。(1)硬件集成:将不同功能的芯片集成于同一块电路板(PCB)上,即被称为硬件集成,其中会包含核心处理器、协处理器(加速芯片)、存储器和其他零件。硬件集成初级的产品是板上系统(systemonboard),但终极目标是将多个芯片集成在一块芯片上形成系统芯片,或称片上系统(systemonchip),如图7所示。

(2)软件集成:根据集成硬件的需求或纯粹软件集成的需求,软体工程师将不同软件(software)和固件(firmware)集成起来安装到板上系统或片上系统中。因AI芯片设计的难度并没有过往的CPU高,为增加行业竞争优势,人工智能企业除本身提供的系统集成服务外,也开始往芯片设计方向整合。与此同时,AI芯片企业为了加速产品落地,减少寻找客户的难度,会同时兼任芯片企业和集成商这两种身份。于是,目前行业呈现人工智能与芯片产业双向整合的情况。整合后的AI系统集成商可以将更高性能、更低价格、更低功耗的系统芯片(片上系统)方案提供给客户。

4.6存在的问题

因系统芯片开发技术复杂,人才缺口成为首要难题。系统芯片设计的关键技术包含但不限于以下6项:(1)总线架构技术;(2)IP核可复用技术;(3)软硬件协同设计技术;(4)时序分析技术;(5)验证技术;(6)可测性设计技术。以上关键技术皆涉及跨学科知识,且开发流程复杂,工序可多达40个,每个工序都需要一位专业工程师负责执行工作,开发过程需要前后反复多次验证设计,避免流片失败。

系统芯片(SoC)设计与AI加速芯片(ASIC)设计相比,前者的设计难度更高,两者之间的差异主要表现在以下两点:第一,系统芯片设计需要更加了解整个系统的运作,由此可更合理的定义芯片架构,使得软硬件集成达到系统最佳工作状态。第二,系统芯片设计是以IP核复用为基础,基于IP模块的大规模集成电路设计是系统芯片实现的关键。综上所述,系统芯片设计团队或以系统芯片为目标创立的AI芯片企业,首先面临的是人才技术储备问题,再来才是后续问题。

4.7AI芯片落地情况分析

现如今,云端与终端皆有AI芯片落地。其中服务器、手机、智能家居、自动驾驶是主要落地场景。由于AI芯片是实现人工智能用途或深度学习应用的专用芯片,芯片与算法的结合程度高,因此接下来将会按照用途、部署位置以及应用场景来讨论AI芯片的落地及相关市场规模。

在人工智能的技术基础上,深度学习算法对于使用者来说会有“训练”和“推理”两种用途,这是因为深度学习算法就如同人类的大脑一样,需要经过学习才能做出判断,就像人要能辨识猫狗,首先需要学习了解猫狗的特征。因此,企业在部署人工智能设备时,也会经历算法/模型训练,再进行推理应用。一般来说,如图8所示,执行训练任务的AI芯片仅会部署在云端和边缘端上,而执行推理任务的AI芯片会部署在云端、边缘端和终端上,应用范围更广,这是因为推理的算力需求较低。应用场景和深度学习算法的类型有关。

计算机视觉通常会使用卷积神经网络(CNN)训练模型,自然语言处理(NLP)则会使用循环神经网络(RNN)训练模型,AI芯片也主要应用于视觉和语言。但是,相较于CNN和RNN等较旧的算法,现在深度学习算法持续在演变中,因此行业应用时并不局限于上述两类算法。每家人工智能企业都有自己独特的算法,AI芯片企业也是一样,会根据自己的改良算法来设计AI芯片。

4.7.1云端市场

随着云端市场需求不断上升,服务器AI芯片的市场前景乐观。按照AI芯片的部署位置,可简单将AI芯片市场分成云端(边缘端并入云端)市场和终端市场两类,具有云计算需求的行业主要是金融业、医疗服务业、制造业、零售/批发以及政府部门等5大行业。

根据IDC数据,如图9所示,云计算需求增长快速,在2018~2019年全球云计算支出将迎来大幅度增长,5大行业的支出最低增长17.3%,最高26.3%,其中以医疗业的需求最高,超100亿美元。与此同时,根据IDC数据,2018年第三季度全球服务器设备的出货量达320万台,营收达234亿美元以上,从出货增长率来看,2018年全年营收达1000亿美元以上,远超过2017年营收669亿美元。

云计算支出的快速增长,代表云计算的需求旺盛。服务器的出货量持续提升,也意味着部署服务器的AI芯片的需求量跟着提升。由此可见,云端芯片的市场未来将快速增长。

4.7.2终端市场

当前的终端市场上,主要有两大落地场景,一个是智慧型手机,另一个是物联网设备。手机又被称作移动端,在智慧型手机上,AI芯片的主要任务是拍照后的图像处理,以及协助智慧助理的语音处理。根据IDC的数据,全球智慧型手机出货量已经连续两年超过14亿部,其中全球前5大厂商中有3家是中国企业,按2018年出货量由高到低排序依次为,华为2.06亿部、小米1.23亿部,和OPPO1.13亿部。

除手机之外,物联网也是当前终端市场中重要的一部分。根据IDC数据,物联网的市场主要在产业应用上,制造业、运输业和公用事业合计超过3290亿美元,其中消费性产品(包含智能家居、穿戴设备、智慧座舱等)占1080亿美元。AI芯片在物联网产品上的应用主要有两个用途,一个是视觉AI芯片,另一个是语音AI芯片,但因为自然语言处理的AI产品开发难度高,目前新创AI芯片企业主要切入的市场是计算机视觉设备的落地场景,比如家庭安全设备。根据IDC数据,全球智能家居市场中的家庭安全设备出货量已达9770万台,而智能音箱也有9980万台设备,两类设备至2022年都会增长超过2亿以上。总而言之,物联网在智能家居场景落地可以保证具有千万销售量的市场。

未来,自动驾驶将是终端芯片应用的另一块重要场景。根据MARKLINES的数据,2014年中国汽车销售量为2349.2万辆,2018年已增长至2808.1万辆。中国千万量级汽车销售市场对于开发自动驾驶技术的企业具有极大吸引力。纵然中国汽车销售量已达千万量级,但目前电动车销售量仍不及整体汽车销售量的10%,而自动驾驶技术的发展是以电动车为主,电动车市场有很大的增长空间。

结论

目前,我国的人工智能芯片行业发展尚处于起步阶段。长期以来,中国在CPU、GPU、DSP处理器设计上一直处于追赶地位,绝大部分芯片设计企业依靠国外的IP核设计芯片,在自主创新上受到了极大的限制。然而,人工智能的兴起,无疑为中国在处理器领域实现弯道超车提供了绝佳的机遇。人工智能领域的应用目前还处于面向行业应用阶段,生态上尚未形成垄断,国产处理器厂商与国外竞争对手在人工智能这一全新赛场上处在同一起跑线上。因此,基于新兴技术和应用市场,中国在建立人工智能生态圈方面将大有可为。

由于我国特殊的环境和市场,国内AI芯片的发展目前呈现出百花齐放、百家争鸣的态势,AI芯片的应用领域也遍布股票交易、金融、商品推荐、安防、早教机器人以及无人驾驶等众多领域,催生了大量的人工智能芯片创业公司,如北京地平线信息技术有限公司、北京深鉴科技有限公司、北京中科寒武纪科技有限公司等。尽管如此,国内公司却并未如国外大公司一样形成市场规模,反而出现各自为政的散裂发展现状。除了新兴创业公司,国内研究机构如北京大学、清华大学、中国科学院等在AI芯片领域都有深入研究;而其他公司如百度和北京比特大陆科技有限公司等亦在积极布局人工智能芯片产业。可以预见,未来谁先在人工智能领域掌握了生态系统,谁就掌握住了这个产业的主动权。

三星将推出Galaxy Tab Active 5平板电脑:Exynos 1380芯

三星将推出Galaxy Tab Active 5平板电脑:Exynos 1380芯